La inteligencia artificial (IA) ha revolucionado numerosos aspectos de nuestra vida, desde la medicina hasta los negocios. Sin embargo, su integración en sistemas de defensa, especialmente aquellos que involucran armas nucleares, plantea una serie de preguntas éticas y de seguridad que exigen una atención urgente.

La IA en el Ámbito Militar

La IA ofrece a los militares una serie de ventajas: análisis de datos más rápidos y precisos, toma de decisiones automatizada y sistemas de armas más autónomos. En el contexto de las armas nucleares, la IA podría utilizarse para:

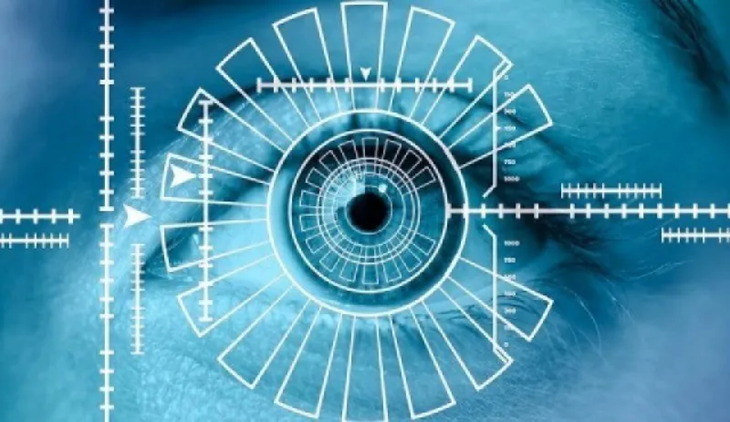

- Detección de amenazas: Identificar y rastrear misiles balísticos con mayor rapidez y precisión.

- Toma de decisiones: Evaluar la naturaleza de una amenaza y recomendar una respuesta, incluyendo el uso de armas nucleares.

- Control de sistemas de armas: Dirigir misiles y otros sistemas de armas de manera autónoma.

Los Riesgos y Desafíos

Si bien los beneficios de la IA en el ámbito militar son evidentes, también existen riesgos significativos:

- Riesgo de errores: Los sistemas de IA, por sofisticados que sean, son susceptibles a errores. Un error de cálculo o una interpretación errónea de los datos podrían desencadenar una respuesta nuclear no deseada.

- Falta de transparencia: La complejidad de los algoritmos de IA dificulta la comprensión de cómo llegan a sus conclusiones. Esto puede limitar la capacidad de los humanos para verificar y controlar las decisiones tomadas por estos sistemas.

- Carrera armamentística: La proliferación de armas autónomas impulsadas por IA podría desencadenar una nueva carrera armamentística, aumentando el riesgo de conflictos.

- Dilemas éticos: La delegación de decisiones de vida o muerte a máquinas plantea profundas cuestiones éticas. ¿Quién es responsable si un sistema de IA toma una decisión que resulta en la muerte de civiles?

La Necesidad de Regulación

Ante estos riesgos, es imperativo desarrollar marcos regulatorios sólidos para el desarrollo y uso de la IA en el ámbito militar. Algunas de las medidas que podrían considerarse incluyen:

- Prohibiciones claras: Algunos expertos abogan por prohibir por completo el desarrollo de sistemas de armas totalmente autónomos que puedan seleccionar y atacar objetivos sin intervención humana.

- Supervisión humana: Es esencial garantizar que los humanos siempre mantengan el control final sobre las decisiones de usar armas nucleares.

- Transparencia: Los desarrolladores de sistemas de IA deben ser transparentes sobre cómo funcionan sus algoritmos y cómo se toman las decisiones.

- Cooperación internacional: La regulación de la IA en el ámbito militar requiere una cooperación internacional estrecha para evitar una carrera armamentística descontrolada.

Conclusión

La IA ofrece un enorme potencial para mejorar la seguridad nacional, pero también plantea riesgos significativos. Es crucial abordar estos desafíos de manera proactiva y desarrollar marcos regulatorios sólidos para garantizar que el desarrollo y uso de la inteligencia artificial en el ámbito militar sea seguro y responsable. La humanidad se encuentra en un punto de inflexión y las decisiones que tomemos hoy tendrán un impacto duradero en nuestro futuro.

Pingback: El Modelo Strawberry: La nueva fruta en el Jardín de la IA - Nerdilandia

Pingback: Crea anuncios con una sola imagen lo nuevo de Amazon IA - Nerdilandia